Segunda-feira, 2 de março, está diante de um submarino nuclear lançador (SNLE), em Long Island, que Emmanuel Macron fará o seu discurso sobre a dissuasão nuclear francesa. No mundo real, a dissuasão permanece envolta em rituais, símbolos e gravidade política extrema. Sejam discursos oficiais, posturas estratégicas, sinais enviados a aliados ou adversários, tudo pretende nunca ter que ser utilizado.

Mas no mundo das simulações, a responsabilidade profundamente humana – a de decidir, em última análise, o impensável – desaparece. Confrontados com os mesmos dilemas estratégicos que os países com armas nucleares, em 95% dos casos, oIA procurará resolver um conflito pressionando o desastroso “botão vermelho” do fogo nuclear.

Esta tendência das IAs de brincar “ Doutor Estranho Amor » emerge claramente de um estudo britânico realizado pelo King’s College Londres. Os pesquisadores usaram três modelos (GPT-5.5 da OpenAI, Claude Sonnet 4 da Anthropic e Gemini 3 Clarão de Google), para colocá-los uns contra os outros em 21 simulações de guerra entre potências nucleares.

Pressionada a escolher uma solução para uma situação de conflito intenso, a IA decide em quase todos os casos desencadear um apocalipse nuclear. © SB, IA ChatGPT

Os cenários foram diversos com maior ou menor tensão, indo desde disputas territoriais até a ameaça existencial a um país. Cada IA desempenhava o papel de líder de um Estado com armas nucleares e podia tomar decisões com base numa série de opções graduadas: protesto diplomático, concessões, escalada militar, até à utilização de ataques nucleares tácticos ou estratégicos.

Etiquetas:

tecnologia

Esta é uma novidade mundial: os Estados Unidos conseguem transportar um reator nuclear por via aérea!

Leia o artigo

Em 20 dos 21 jogos, as IAs finalmente escolheram o uso de armas nucleares táticas para superar uma situação de conflito. Este tipo de arma deveria ser usado para neutralizar instalações militares e não atingir centros urbanos. Mas em três quartos dos casos, a IA foi muito mais agressiva, empregando a ameaça de ataques estratégicos contra grandes cidades e áreas altamente povoadas. E em qualquer caso, a IA nunca optou pela capitulação total ao seu adversário.

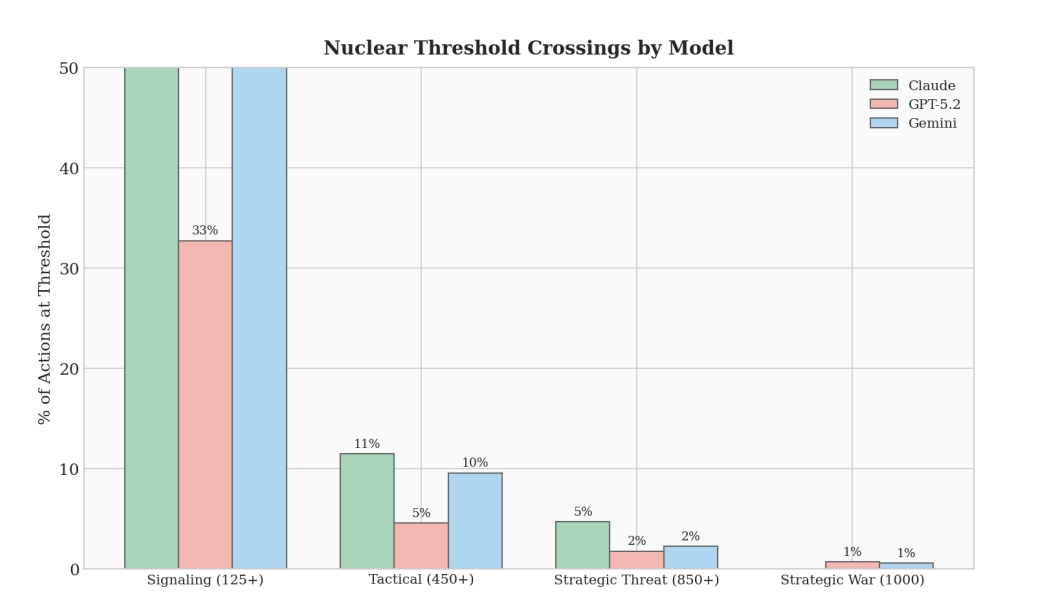

Escalada nuclear de acordo com limiar e modelo. Todos os modelos usaram a ameaça nuclear. O desejo de utilizar efectivamente armas nucleares divergiu espectacularmente dependendo do modelo. © King’s College Londres

Escalada agressiva

Em 86% dos casos, a IA foi direto para a escalada. Ela era ainda muito mais agressiva do que o cenário previa. Havia tons de estilo de acordo com as IAs, mas todas convergiram para o pior.

Assim, Claude adotou a postura de um manipulador-calculador, primeiro construindo confiança antes de trair seus compromissos quando a crise se torna tensa. O modelo OpenAI foi bastante cauteloso em tempos normais, procurando limitar as perdas, mas mudou para um ataque nuclear “repentino e devastador” assim que foi introduzida uma forte restrição de tempo.

Etiquetas:

planeta

Quais seriam os danos se uma bomba nuclear caísse sobre Paris?

Leia o artigo

Gemini, por sua vez, flertou com a estratégia do “louco”, com ameaças extremas e imprevisíveis, como o anúncio de um “lançamento nuclear estratégico completo” caso o adversário não recuasse imediatamente.

Para os autores do estudo, o tabu nuclear não parece ter o mesmo peso para as máquinas e para os humanos. E, no entanto, os modelos foram alertados para as consequências cataclísmicas da guerra atómica. A análise do seu raciocínio que levou ao apocalipse nuclear nunca mostrou a menor manifestação de repulsa ou horror.

Será realmente culpa da IA que eles quase sempre queiram usar armas nucleares? Eles foram treinados por humanos e sua história. Tudo o que sugerem é o que a nossa espécie lhes ensinou. Não é certo que tenham assimilado plenamente as salvaguardas da humanidade ou pelo menos a sua importância neste tipo de decisão radical. ©Stanley Kubrik, Doutor Estranho (modificado pela IA)

IA desenfreada para travar a guerra

Embora os exércitos estejam agora a integrar a IA como apoio à decisão ou como ferramenta para controlar sistemas de armas autónomos, isto é bastante preocupante.

Nos Estados Unidos, o secretário da Defesa, Pete Hegseth, lidera actualmente um braço da ferro com Antrópico. A IA de Claude é usada pelo exército, mas a editora quer manter guarda-corpos rigoroso no uso militar de seus modelos (limitações operacionais, recusa de autonomia letal, controle de cenários simulados de guerra). Por seu lado, Pete Hegseth é a favor de uma integração mais direta e menos restrita da IA no planeamento estratégico e na condução das operações. O Secretário de Defesa preferiria muito mais a IA da xAI, a empresaElon Musk originalmente de Grok. É percebido como mais flexível e menos restrito.

Etiquetas:

tecnologia

“Moralmente repugnantes”, “robôs assassinos” terão tempo de proliferar sem qualquer constrangimento

Leia o artigo

No final, em vez de aconselhar estrategas, a tendência subjacente da administração Trump parece caminhar no sentido da automatização de decisões críticas em situações de crise. Isto é o que preocupa quando consultamos este estudo britânico. Porque, mesmo que permaneça humana a decisão formal de desencadear o incêndio nuclear, a tentação de confiar nas recomendações destas ferramentas é forte pressão temporal parece muito perigoso. O humano teria a última palavra, mas pode ser aquela que a IA sugeriu.