É guerra! Não só no Médio Oriente, mas também entre os teores da IA e a administração Trump. Na semana passada, nos Estados Unidos, o braço da ferro entre o CEO da Anthropic, Dario Amodei, e o secretário de Defesa, Pete Hegseth, terminou em um impasse.

Claude AI tem sido usado pelos militares há vários anos e a Anthropic se recusa a permitir que seus modelos de IA sejam usados para vigilância. massa Americanos e por armas autônomas mortais. Em resposta, o Secretário de Defesa respondeu acusando a Antrópica de tentar “ arrogar o direito de veto sobre as decisões operacionais do exército americano “.

Etiquetas:

tecnologia

Dario Amodei, o arquitecto visionário de uma revolução já em todo o lado

Leia o artigo

Com a sua brutalidade habitual, Pete Hegseth sugeriu remover imediatamente Claude dos sistemas do Pentágono. Ele também assumiu uma certa forma de vingança para enfraquecer ao máximo a Antrópica ao especificar: “ Com efeito imediato, nenhum empreiteiro, fornecedor ou parceiro que faça negócios com as forças armadas dos Estados Unidos poderá conduzir qualquer atividade comercial.” com Antrópico. No processo, Donald Trump ordenou que as agências governamentais federais parassem imediatamente de usar IA. Ciente de que isso não é feito de uma só vez pressão ao premir um botão, foi finalmente decidido que esta retirada ocorreria gradualmente ao longo dos próximos seis meses.

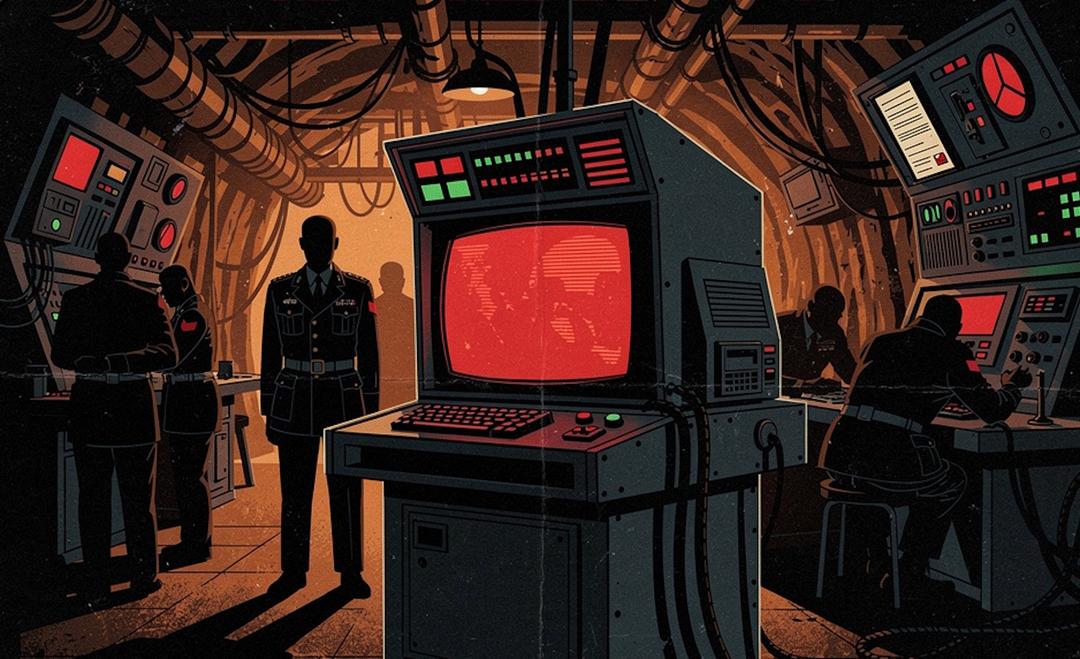

Palantir garante que cada pixel em cada quadro de vídeo do terreno esteja associado a coordenadas geográficas reais. Problema, a IA que comanda o sistema é a da Antrópica. É difícil ficar sem isso no momento. © Palantir

Claude AI fortemente integrado na Palantir

Os fabricantes de defesa que usam Claude estão bastante irritados com esta decisão. Desfazer os laços com um fornecedor de IA profundamente integrado está longe de ser fácil e é ainda menos rápido. Acima de tudo, a empresa mais impactada continua sendo a Palantir. O seu sistema Maven AI é usado ativamente pelos militares dos EUA para liderar atualmente a sua ofensiva no Irão.

Etiquetas:

tecnologia

Khamenei: como uma capital inteira foi transformada em ferramenta de inteligência

Leia o artigo

O problema é que Claude AI está integrado ao Maven há dois anos. A ferramenta é usada para selecionar alvos de ataque no Irã e fornece coordenadas GPS precisas para realizar ataques. mísseis. Entre suas vantagens, permite classificar os alvos em ordem de prioridade.

Maven também foi explorado durante o ataque na Venezuela que levou ao sequestro do seu presidente, Nicolás Maduro. Na verdade, como é impossível respeitar imediatamente esta proibição do uso de Claude, o Pentágono continuará a usar a tecnologia da Antrópico, mesmo que isso signifique contradizer a ordem do presidente de não fazê-lo. Isso será feito até que uma alternativa viável seja encontrada.

Banir brutalmente Claude da Anthropic não ajuda ninguém, exceto o ego marcial do Secretário de Defesa americano que quer ter a última palavra. © SB, IA LeChat

OpenAI em emboscada

A solução está começando a tomar forma desde que a OpenAI aproveitou a pausa para assinar um contrato massivo com o Departamento de Defesa. Uma assinatura que significa para os seus utilizadores que a empresa concorda em processar massivamente os dados das populações americanas para melhor monitorizá-las ou decidir sobre a vida ou a morte de forma autónoma. No processo, um enxame de usuários deixou o ChatGPT em favor de Claude. Bela ironia.

Dados militares à solta?

O facto é que o uso da IA para conduzir a guerra deixa sempre alguém cauteloso. Até agora e mesmo para os ataques realizados no Irão, o Claude AI utilizado diariamente em Palantir não tem o poder de decidir sobre a vida ou a morte. Acima de tudo, permite ao exército desenvolver processos de seleção de alvos baseados em velocidade máquina em vez da velocidade humana.

Mas, como a IA às vezes comete erros, os operadores humanos continuam monitorando a situação, em vez de apertar um botão mortal. No entanto, parece que a administração Trump quer acelerar, confiando inteiramente na IA mais moralmente desenfreada para realizar as suas operações militares. Uma decisão bastante perigosa quando os chatbots mais bem-sucedidos continuam a ter alucinações e devemos controlar constantemente o seu pensamento.

Etiquetas:

tecnologia

Em 95% das simulações, a IA escolheu armas nucleares, sem a menor hesitação

Leia o artigo

Confiar nestas IA para tomar decisões letais no lugar dos humanos coloca, portanto, sérias questões éticas. Questões sobre as quais a administração Trump não deseja insistir.

Outra questão permanece. Que o exército viva sem Claude é uma coisa, mas esta IA engoliu quantidades colossais de dados militares, por vezes confidenciais, para se treinar. O que acontecerá com esses dados? Quando um ator privado como Elon Musk tem poder geoestratégico com os seus satélites, pelo que uma IA – mesmo uma IA ética como Claude – também poderia, intencionalmente ou não, tornar-se uma IA mercenária ao serviço da guerra.