Legendas dos filmes que fazemos em nossas cabeças. As neurotecnologias estão cada vez melhores na “leitura” dos nossos pensamentos, descodificando o que um indivíduo quer dizer, e até mesmo o que pensa, mas não necessariamente quer dizer. Os avanços nesses dispositivos são tantos que eles não se contentam mais em decifrar pensamentos verbais: algumas equipes já mostraram que também é possível “ver” pensamentos visuais, ou seja, adivinhar a imagem que uma pessoa está olhando.

Um novo estudo vai além, descrevendo o conteúdo dos vídeos que assistimos apenas analisando a atividade cerebral. Este novo avanço, apresentado em 5 de novembro de 2025 na revista Avanços da Ciência de um pesquisador da empresa japonesa de comunicação NTT, não se interessa por pensamentos verbais, mas sim por pensamentos visuais, podendo assim possibilitar a decodificação de pensamentos de sujeitos que não dominam a linguagem, como bebês ou animais.

Uma IA para descrever as imagens que observamos

Esta descodificação baseia-se em grande parte na inteligência artificial (IA) concebida para descrever uma sequência de imagens, gerando textos como os utilizados para permitir que pessoas com deficiência visual possam desfrutar de um filme. Este modelo de linguagem é treinado para adicionar gradualmente palavras que descrevem os elementos de uma imagem e como eles interagem. Esse método, chamado de modelagem de linguagem mascarada (MLM), prevê as palavras que faltam em uma frase, adicionando passo a passo todas as descrições necessárias para ter uma boa ideia do que está acontecendo na tela. Então, essas descrições são traduzidas em traços semânticos: por exemplo, se vemos uma cantora na imagem, os traços semânticos poderiam ser “mulher”, “artista”, “cantar”, etc.

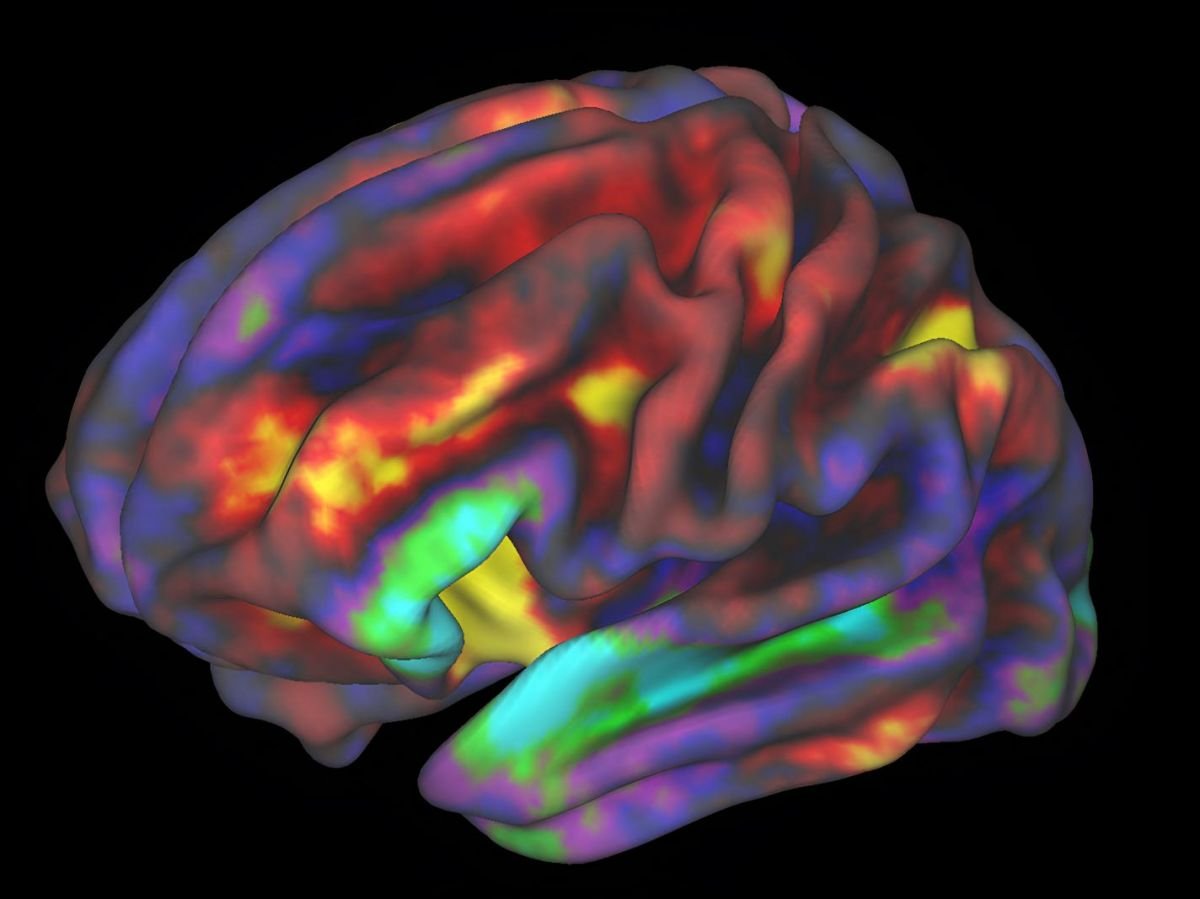

Ao mesmo tempo, o usuário assiste a essa mesma sequência de imagens e a atividade do seu cérebro é registrada por ressonância magnética funcional (fMRI), que permite analisar o fluxo sanguíneo no cérebro e assim saber quais áreas estão ativadas em tempo real. O objetivo é treinar o sistema para associar essa atividade cerebral a características semânticas ligadas às imagens observadas. Para então poder inferir as imagens que o usuário observa ou imagina a partir das características semânticas associadas à sua atividade cerebral.

“Ler” o cérebro para “ver” a imaginação

Este método foi testado em seis participantes, comparando as descrições geradas a partir da atividade cerebral enquanto assistiam a um vídeo com aquelas que a IA produziu diretamente do mesmo vídeo. O objetivo era saber se essas descrições extraídas diretamente do pensamento dos usuários permitiam adivinhar qual vídeo eles estavam assistindo (de um total de 100 vídeos).

A taxa de sucesso de alguns participantes rondou os 40%, sabendo-se que a taxa de sucesso devida unicamente ao acaso (ou seja, se o método não funcionasse) foi calculada em apenas 1%. Ou seja, a leitura da atividade cerebral conseguiu extrair parcialmente descrições que correspondiam bem ao vídeo assistido, mesmo que a eficiência pudesse ser melhorada ainda mais. E funcionou mesmo quando o participante não estava assistindo diretamente ao vídeo, mas lembrava dele, mostrando que essa técnica também poderia possibilitar adivinhar o que imaginamos, e não apenas o que vemos.

Previsões que não dependem do idioma

Poderíamos imaginar que a geração dessas descrições na mente utiliza a linguagem e que o cérebro poderia traduzir o que vê em palavras para melhor compreendê-lo. E então este método poderia ser simplesmente capturar essas palavras que o cérebro diz para si mesmo enquanto assiste ao filme. Mas não é assim, estas descrições geradas pelo pensamento eram de facto devidas a pensamentos visuais e não a pensamentos verbais.

Dois experimentos permitem confirmar isso: primeiro, durante o período de preparação, quando os participantes estão em frente à tela e se preparando para assistir ao vídeo, eles podem ler o texto descritivo gerado upstream pela IA que descreve o vídeo. No entanto, a atividade cerebral registada naquele momento produziu descrições muito menos precisas do que quando assistiram ao vídeo. Em segundo lugar, a análise apenas de regiões cerebrais dedicadas à linguagem não produziu descrições tão detalhadas como a análise de todo o cérebro, incluindo regiões cruciais para o processamento de informação visual. Ou seja, foram principalmente as imagens recriadas na mente que permitiram produzir boas descrições.

Essa capacidade de “ver” o que o cérebro vê poderia ser utilizada principalmente para pessoas que não dominam a linguagem, seja por acidente ou doença que afete a região necessária ao processamento dessa informação, seja porque o indivíduo não fala a língua utilizada pelo método (inglês). O artigo de pesquisa vai além e ainda propõe que esse método possa ser usado para decodificar o pensamento de bebês ou animais, contornando as barreiras linguísticas.

Contudo, o autor alerta também que este método é apenas interpretativo: não recria uma reconstrução literal do pensamento, mas interpreta-o de acordo com o modelo de linguagem utilizado (e seus preconceitos). Então o pensamento é filtrado de certa forma, para que possa ser compreendido pela IA. Por fim, levanta uma questão essencial: qual é o risco ético de poder aceder ao pensamento com simples ressonâncias magnéticas, utilizadas regularmente na clínica e na investigação? E recorda a urgência de regulamentar estas neurotecnologias para salvaguardar a privacidade dos utilizadores, para garantir que estes filmes “que fazemos na nossa cabeça” não saiam, a menos que realmente queiramos.