Et si vous aviez votre propre IA, 100 % locale, sans internet et privée ? Ce guide vous montre comment faire tourner un LLM sur votre PC, même sans être un pro.

Savez qu’il est possible d’avoir votre propre ChatGPT, qui tourne directement sur votre ordinateur, sans dépendre d’un service en ligne ? Les grands modèles de langage, ou LLM (Large Language Models), ne sont plus réservés aux géants du cloud. Aujourd’hui, avec un PC ou Mac correct et quelques astuces, vous pouvez les installer chez vous.

Pourquoi ? Pour garder vos données privées, éviter les abonnements coûteux ou simplement bidouiller une IA à votre sauce. Dans ce guide, on vous explique tout, pas à pas.

Qu’est-ce qu’un LLM ? C’est comme ChatGPT ?

Un LLM, ou Large Language Model (grand modèle de langage en français), c’est une IA entraînée sur des montagnes de textes pour comprendre et générer du langage humain. Concrètement, ça veut dire qu’il peut discuter, répondre à des questions, écrire des trucs ou même coder, un peu comme un super assistant virtuel. Le principe, c’est qu’on lui donne une instruction (un prompt), et il utilise ses milliards de paramètres, des sortes de connexions apprises, pour pondre une réponse cohérente. ChatGPT est un exemple célèbre de LLM, créé par OpenAI, mais il y en a plein d’autres, comme LLaMA, Mistral ou DeepSeek, souvent gratuits et open-source.

Pour aller plus loin

C’est quoi un LLM ? Comment fonctionnent les moteurs de ChatGPT, Gemini et autres ?

Alors, est-ce que c’est exactement comme ChatGPT ? Pas tout à fait. ChatGPT est une version ultra-polie et optimisée d’un LLM, avec des guardrails (des limites) pour rester safe et une interface toute prête dans le cloud. Les LLM qu’on peut installer en local, eux, sont souvent plus bruts : ils dépendent de comment vous les configurez et de votre matos (PC ou Mac).

Ils peuvent être aussi puissants, voire personnalisables à fond, vous pouvez les entraîner sur vos propres textes , mais ils n’ont pas toujours le même vernis ou la même facilité d’accès que ChatGPT. Vous pouvez aussi avoir une interface aussi intuitive que ChatGPT, cela dépend de vos besoins.

Enfin, on évoque aussi les agents IA. Ces agents servent principalement à automatiser des tâches autonomes sur votre machine, en traitant vos données privées sans les envoyer sur le cloud, pour une confidentialité maximale. Ils analysent, décident et agissent seuls (fichiers, code, web), avec une latence nulle et zéro coût récurrent.

Pourquoi installer un LLM en local sur son PC ?

Commençons par le plus gros avantage : la confidentialité. Quand vous utilisez une IA en ligne, vos conversations partent souvent sur des serveurs lointains. Plusieurs pannes chez ChatGPT, Grok ou Gemini ont eu lieu, ces services sont loin d’être 100 % disponibles, et surtout 100 % safe.

Une panne en 2023 chez OpenAI a montré que des historiques d’utilisateurs pouvaient fuiter par erreur – pas très rassurant si vous parlez des données sensibles. Avec un LLM local, tout reste chez vous. Rien ne sort de votre ordi, point final. C’est un argument de poids pour les entreprises ou les paranoïaques de la vie privée.

Ensuite, il y a l’autonomie. Pas besoin d’Internet pour faire tourner votre IA maison. Que vous soyez en pleine campagne ou dans un avion, elle répondra présente. Et côté vitesse, si votre machine est bien équipée, vous évitez les allers-retours réseau qui ralentissent parfois les services cloud. Comme vous allez le voir, même sur un MacBook M1 bien optimisé, un LLM local dépasse un PC classique en réactivité. Ajoutez à ça l’absence de pannes serveur ou de quotas imposés par un fournisseur, et vous êtes libre comme l’air.

Et les coûts, dans tout ça ? À première vue, il faut un peu investir dans du matériel (on en reparle plus loin), mais sur le long terme, c’est souvent plus rentable que de payer une API cloud au mot généré. Pas de facture surprise ni de hausse de tarif imprévue. Une fois votre PC ou GPU prêt, votre IA ne vous coûte que quelques watts d’électricité.

Enfin, le top du top : vous pouvez personnaliser votre modèle. Changer ses paramètres, l’entraîner sur vos propres textes, voire le brancher à vos applications personnelles – avec un LLM local, vous êtes aux commandes.

Mais attention, ce n’est pas magique. Il faut une machine qui tient la route, et l’installation peut intimider les débutants. Les modèles les plus énormes, ceux avec des centaines de milliards de paramètres, restent hors de portée des PC classiques – là, on parle de supercalculateurs. Cela dit, pour des usages courants (chat, rédaction, code), les modèles open-source plus légers font largement l’affaire.

Quels modèles de LLM choisir ?

Côté modèles, il y a du choix.

| Modèle | Usage principal | RAM | Vitesse (tokens/s) |

|---|---|---|---|

| Qwen3 14B | Codage, multilingue | 10 Go | 35+ |

| DeepSeek V3.2 14B | Maths, débogage | 9 Go | 40+ |

| Mistral Large 3 / Ministral 14B | Chat créatif, raisonnement | 12 Go | 30+ |

| Llama 4 70B (MoE) | Chat général, contextes longs | 40 Go | 25+ |

| GLM-4.7 / GLM-5 | Raisonnement avancé | 18 Go | 28+ |

| Gemma 4 E2B/E4B (Google) | Edge/mobile, instructions | 3-5 Go | 80+ |

| Gemma 4 26B MoE | Agentic/codage local | 15 Go | 40+ |

| Phi-4 14B (Microsoft) | Codage léger, général | 8 Go | 50+ |

| Gemma 3 9B (Google) | Chat rapide, multilingue | 6 Go | 60+ |

| Qwen3 4B | Instructions basiques | 3 Go | 80+ |

| Llama 4 8B | Usage mobile/léger | 5 Go | 70+ |

| Mistral Nemo 12B | Raisonnement compact | 7 Go | 45+ |

Prenons DeepSeek V3.2 (successeur de R1, début 2026), par exemple. Ce modèle open-source cartonne avec ses versions 14B et 32B de paramètres, ultra-fort en raisonnement, maths et génération de code, la 14B tourne nickel sur 9 Go VRAM.

Autre star : Llama 4, créé par Meta. Hyper populaire grâce à sa flexibilité MoE (70B actifs sur 400B+ totaux) et sa licence gratuite même pro ; le 8B pour débuter, le 70B pour du lourd.

Il y a aussi Mistral Large 3 (français), avec 123B params MoE. Il bat des modèles propriétaires sur plusieurs benchmarks codage/multilingue, tout en restant efficace (15 Go VRAM Q4). Idéal avec RTX 30/40-series avec au moins 12 Go de VRAM.

Mistral Small 3.1, dernier de Mistral AI (sorti Q1 2026), est conçu léger et puissant avec 24B paramètres. Il rivalise GPT-4o mini en chat/codage, et fonctionne sur PC/Mac avec 12 Go de VRAM.

Google a aussi son LLM open-source, il se nomme Gemma, une famille de modèles optimisés pour une exécution locale. Gemma 4 sont conçus pour fonctionner sur des machines très diverses, pour Mac M1 à M5 et PC Nvidia RTX/AMD Radeon, avec contexte 128k+ et support Ollama natif.

La liste des LLM open-source s’allonge chaque mois. Mentionnons GPT4All, qui regroupe 2000+ modèles prêts via interface unifiée : DeepSeek V3.2, Llama 4, Mistral, Gemma 4, Qwen3, Phi-4 et plus – parfait pour tester vite.

En somme, vous avez l’embarras du choix, du petit modèle ultra-léger à exécuter sur CPU jusqu’au grand modèle quasi équivalent à ChatGPT si vous avez la machine adéquate. Le tout est de sélectionner celui qui correspond à vos besoins (langue, type de tâche, performances) et à votre matériel.

Niveau matériel, pas besoin d’un supercalculateur, même si ces derniers deviennent de plus en plus personnels, avec ce que Nvidia et AMD lancent cette année… et même un Mac Studio.

Pour aller plus loin

Voici les deux premières machines de Nvidia pour faire de l’IA à la maison : des PC qui sont des supercalculateurs personnels

Un PC avec un processeur récent (genre Intel i7 ou AMD Ryzen 7), au moins 16 Go de RAM et une carte graphique NVIDIA (8 Go de VRAM minimum) fait le job. Si vous avez un GPU RTX 3060 ou mieux, c’est le bonheur – grâce à CUDA, ça accélère tout.

Notez qu’un GPU n’est pas obligatoire, mais fortement recommandé pour bénéficier de performances interactives. Pour les LLM, la mémoire vidéo (VRAM) est primordiale : il faut qu’elle puisse contenir au moins une partie des paramètres du modèle. La taille de la fenêtre de contexte (mémoire de la conversation) dépend elle aussi de la VRAM disponible… c’est pour ça que 8 Go de VRAM minimum est le minimum. En pratique : un modèle Llama 7B en 4 bits consomme ~4 Go VRAM, un 13B ~8 Go, un 30B ~16 Go, un 70B ~32 Go. D’ailleurs, même Nvidia pour son outil Chat With RTX exige une RTX 30/40 avec au moins 8 Go VRAM et 16 Go de RAM système.

Pour aller plus loin

Meilleures cartes graphiques 2026 : quel GPU choisir pour votre PC ?

Sur Mac, les puces M1/M2 avec 16 Go de RAM marchent bien aussi, même sans GPU dédié, grâce à des optimisations comme Metal. Evidemment, plus on a une puce récente et puissante et plus on a de mémoire vive unifiée… mieux c’est.

Pour aller plus loin

Quels sont les meilleurs ordinateurs d’Apple en 2026 (MacBook et Mac de bureau) ?

Stockage ? Prévoyez 10 à 40 Go sur un SSD pour les fichiers du modèle. Avec ça, vous pouvez déjà faire tourner un Mistral 7B ou un LLaMA 2 13B sans galérer. Un SSD est fortement conseillé pour charger plus rapidement les modèles en mémoire… Si vous comptez essayer plusieurs modèles, quelques dizaines de Go de libre sont nécessaires.

Jusqu’à 600€ offert sur les boitiers et optiques OM SYSTEM

Explorez les couleurs du printemps et partez à l’aventure avec les hybrides et objectifs OM SYSTEM. Vivez la photographie professionnelle au meilleur prix avec des offres allant jusqu’à 600 € offerts.

Installation d’un LLM sur notre machine

Comme on l’expliquait plus haut, tout dépend de vos besoins, de vos objectifs et de votre niveau technique.

| Niveau | Objectif | Exemples d’outils |

| 🟢 Débutant | Interface simple, prêt à l’emploi | LM Studio, GPT4All, Chat With RTX |

| 🔵 Intermédiaire | Ligne de commande, contrôle plus précis | Ollama, Llama.cpp, LocalAI |

| 🔴 Avancé | Personnalisation, fine-tuning | Hugging Face Transformers, Text-Generation-WebUI |

J’imagine que vous êtes excités désormais, passons donc à la pratique.

Débutant : interface visuelle

L’idée ici est de télécharger un modèle et l’utiliser comme un chatbot, sans passer par des lignes de commande.

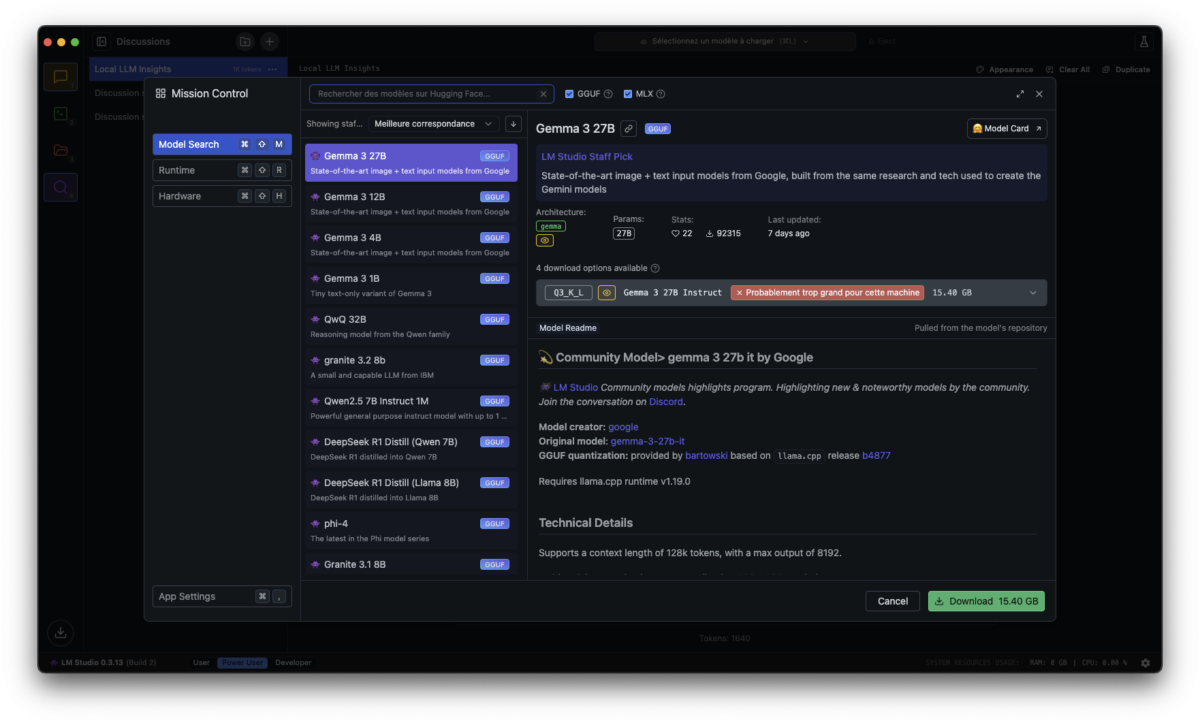

LM Studio

Si vous cherchez une solution prête à l’emploi, sans ligne de commande, avec une interface agréable qui ressemble à ChatGPT, LM Studio est probablement le meilleur choix. Cette application permet de télécharger un modèle, de le lancer et de discuter avec lui en quelques clics.

Sur Windows, macOS et Linux, l’installation est rapide. Il suffit de vous rendre sur le site officiel, lmstudio.ai, de télécharger l’installateur correspondant à votre système et de l’exécuter.

Sur Mac, glissez simplement l’application dans le dossier Applications. Sur Windows, lancez l’exécutable et suivez les étapes classiques d’installation. Une fois LM Studio ouvert, l’interface vous propose d’aller chercher un modèle de langage. Une section dédiée vous affiche les modèles disponibles, avec des descriptions et des recommandations. Pour un bon équilibre entre performances et qualité des réponses, Mistral 7B est un excellent point de départ. Il ne pèse que quelques Go et tourne bien sur la plupart des machines récentes.

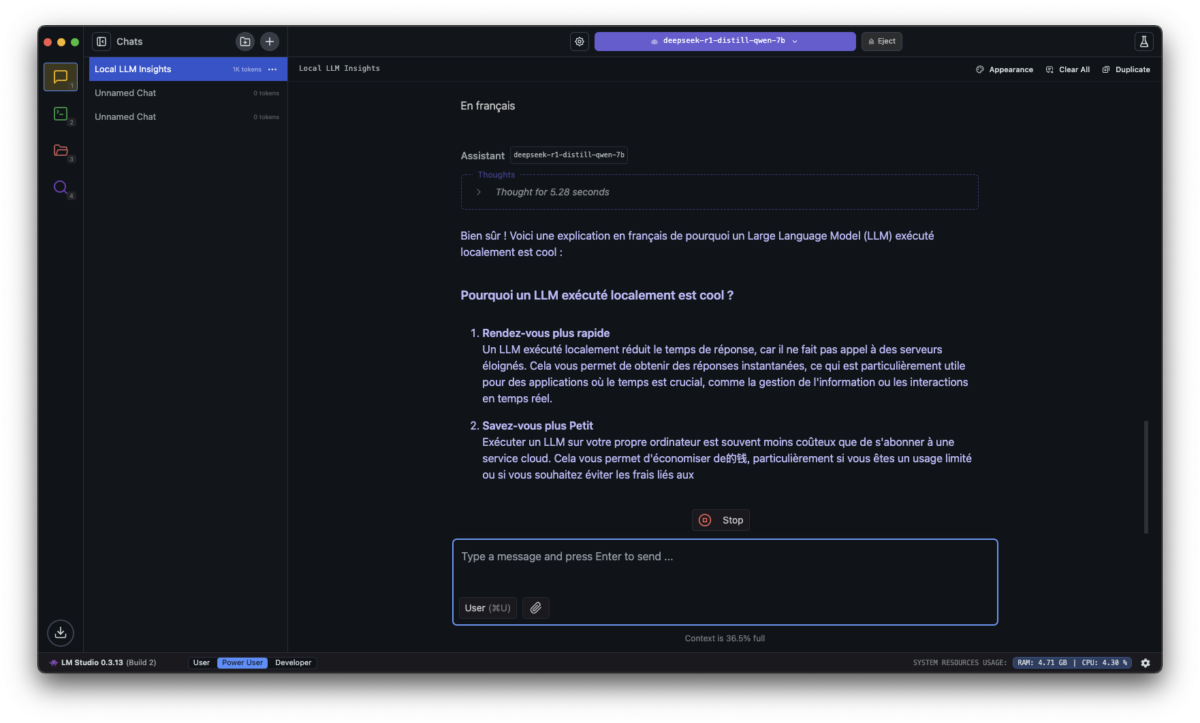

Une fois votre modèle téléchargé, direction l’onglet « Chat ». Vous pouvez taper n’importe quelle question et l’IA vous répond immédiatement, en local, sans passer par un serveur distant. Si vous voulez pousser un peu plus loin, LM Studio permet d’ajuster des paramètres comme la longueur de réponse, la créativité du modèle ou encore la gestion de la mémoire conversationnelle.

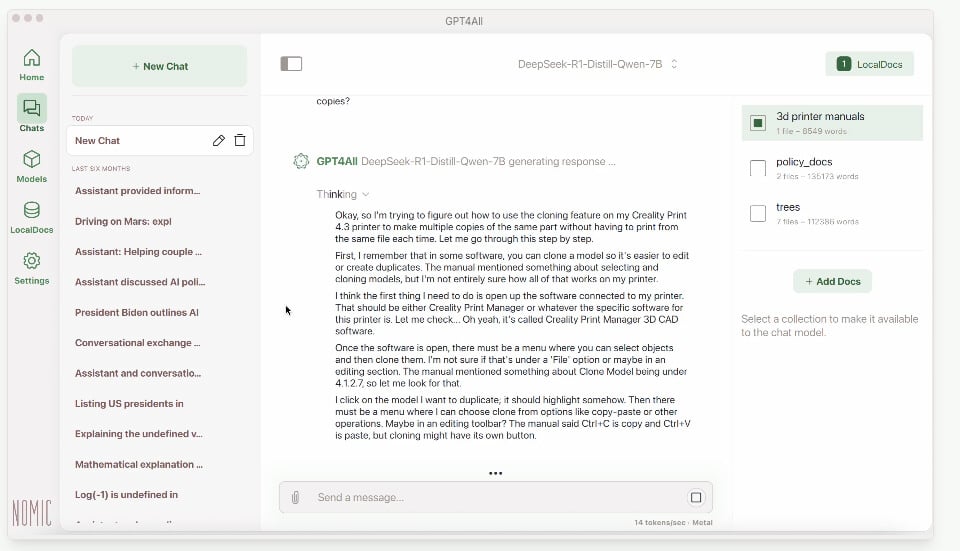

GPT4All

Si vous voulez alternative, GPT4All propose une approche similaire. Son interface est un peu plus rudimentaire mais reste simple à utiliser. Là aussi, vous pouvez télécharger des modèles open-source comme Llama 2 ou DeepSeek, et les utiliser en local avec une interface de chat intuitive.

L’installation est tout aussi facile : il suffit de télécharger l’application depuis gpt4all.io, de l’installer, puis de choisir un modèle pour commencer à discuter.

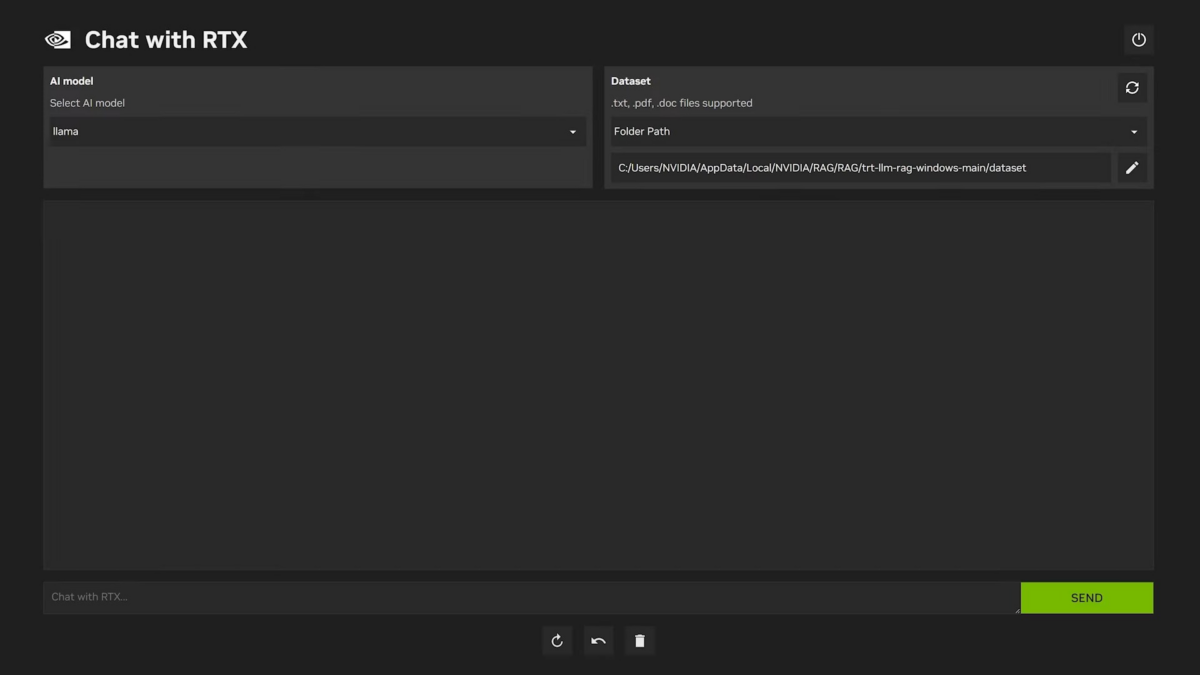

Chat with RTX

Si vous avez carte graphique NVIDIA RTX, vous pouvez aussi essayer Chat With RTX, une solution proposée directement par NVIDIA.

Elle est spécialement optimisée pour tirer parti des GPU RTX et permet d’exécuter des modèles comme Llama 2 ou Mistral 7B avec une fluidité impressionnante. Le téléchargement se fait depuis le site officiel de Nvidia et l’installation est aussi simple que celle d’un jeu vidéo. L’application propose une interface épurée où vous pouvez tester directement le modèle et voir les performances offertes par votre GPU.

Intermédiaire : lignes de commande et polyvlance

Si vous voulez plus de contrôle sur le fonctionnement du modèle, l’exécuter via la ligne de commande est une excellente option.

Ollama

Cela vous permet de gérer les modèles plus finement, d’optimiser leurs performances et même de les appeler depuis d’autres applications. La solution la plus accessible pour utiliser un LLM en ligne de commande, sans trop de complexité, c’est Ollama.

Sur Mac et GNU/Linux, l’installation est particulièrement simple grâce à Homebrew. Une seule commande dans le terminal suffit : winget install Ollama ou curl -fsSL https://ollama.ai/install.sh | sh.

Une fois installé, l’utilisation est tout aussi simple. Pour télécharger et exécuter un modèle, il suffit de taper dans le terminal : ollama run mistral… Le modèle se télécharge automatiquement et se lance en quelques secondes. Vous pouvez maintenant lui poser n’importe quelle question, directement en ligne de commande.

Ollama intègre désormais MLX pour accélérer les Mac M5 (jusqu’à 35+ tokens/s sur Qwen3 14B) et un plugin Web search natif.

Si vous voulez un contrôle encore plus fin sur les modèles, Llama.cpp est une alternative plus technique, mais ultra performante. Il fonctionne sur toutes les plateformes et permet d’optimiser l’exécution des modèles selon le matériel disponible. L’installation demande quelques étapes supplémentaires.

Llama.cpp est particulièrement utile si vous voulez expérimenter différents niveaux de quantification, c’est-à-dire réduire la taille mémoire du modèle en compressant certains calculs pour améliorer les performances. C’est un excellent outil pour obtenir de meilleures performances sur des machines modestes, tout en gardant un bon niveau de qualité des réponses.

Utiliser un LLM en ligne de commande vous donne aussi accès à des intégrations plus flexibles. Vous pouvez par exemple brancher Ollama ou Llama.cpp à un script Python, ou encore les utiliser en mode serveur pour interagir avec une API locale. C’est une excellente manière d’avoir un assistant IA plus puissant et adaptable que ce que propose une interface graphique standard.

Si vous voulez intégrer un LLM dans un site web, voici comment exposer Ollama comme API locale : ollama serve… Cela ouvre une API compatible avec OpenAI sur http://localhost:11434. Maintenant, vous pouvez interroger votre LLM depuis une page web, en local, sans dépendance externe.

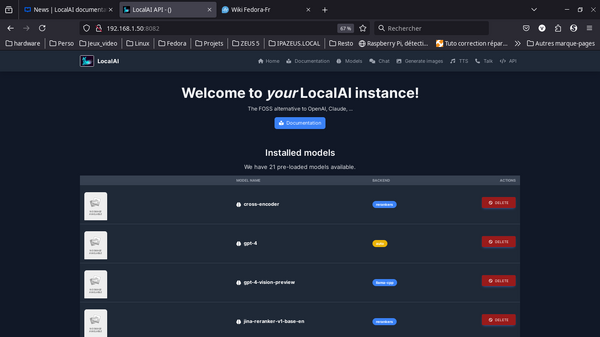

LocalAI

Si vous cherchez une solution plus polyvalente qui ne se limite pas à la génération de texte, LocalAI est un excellent choix. Contrairement aux outils comme LM Studio ou GPT4All, qui se concentrent sur les LLM, LocalAI est conçu comme une alternative open-source aux API d’OpenAI. Il permet non seulement d’exécuter des modèles de langage, mais aussi de gérer des fonctionnalités avancées comme la transcription audio, la génération d’images ou encore l’intégration avec des bases de données vectorielles.

L’installation est assez simple et fonctionne sur Windows, macOS et Linux. Sur une machine Linux ou Mac, on peut l’installer via Docker pour éviter d’avoir à configurer manuellement les dépendances. Une commande suffit pour lancer un serveur LocalAI prêt à l’emploi, tout est bien documenté.

Une fois lancé, LocalAI propose une API 100% compatible avec OpenAI, ce qui signifie que toutes les applications qui utilisent des requêtes OpenAI (comme ChatGPT API) peuvent être redirigées vers votre serveur local. Vous pouvez ensuite ajouter des modèles en les téléchargeant directement depuis Hugging Face ou en utilisant des backends comme llama.cpp pour les modèles de texte, whisper.cpp pour la transcription audio ou encore Stable Diffusion pour la génération d’images.

Si vous êtes à l’aise avec les lignes de commande et que vous cherchez une solution qui va bien au-delà du simple chatbot, LocalAI est un outil puissant qui mérite d’être testé. En combinant modèles de texte, reconnaissance vocale, génération d’images et embeddings, il transforme votre ordinateur en véritable assistant IA local, capable de traiter différents types de données sans jamais envoyer une requête sur Internet.

Avancé : personnalisation et fine-tuning

Si vous voulez aller encore plus loin, il est possible de personnaliser votre modèle et même de l’entraîner sur vos propres données. Pour cela, l’outil de référence est Hugging Face Transformers. Cette bibliothèque open-source permet de télécharger, exécuter, modifier et entraîner des modèles de manière ultra flexible.

L’installation est relativement simple. Sur Windows, macOS et Linux, il suffit d’installer les bibliothèques nécessaires avec pip : pip install torch transformers accelerate.

Ensuite, les choses se corsent, il faut utiliser un script python pour charger le modèle et générer du texte…. L’avantage de cette approche est que vous pouvez modifier les hyperparamètres, affiner les réponses et tester plusieurs modèles très facilement.

Si vous voulez personnaliser un modèle avec vos propres données, vous pouvez utiliser QLoRA, une technique qui permet de fine-tuner un LLM sans nécessiter une énorme puissance de calcul. Cela vous permet par exemple de spécialiser un modèle sur un domaine spécifique (finance, droit, santé). Mais entre nous, si vous arrivez là, c’est que vous n’avez pas besoin de nous.

Bonus : sur smartphone

Sur smartphone, c’est également très simple. Avec l’application AI Edge Gallery, Google peut charger un LLM et le faire tourner.

En s’appuyant sur les modèles Gemma 4, cette plateforme permet d’exécuter des tâches complexes comme l’analyse d’images via le module Ask Image ou la transcription audio avec Audio Scribe, le tout sans envoyer le moindre octet dans le cloud.

Le point le plus impressionnant, c’est la polyvalence de cette gamme Gemma 4 en usage mobile. Bien qu’ils soient compacts (entre 2,5 et 4 Go selon la version), ces modèles ne font pas de la figuration : ils gèrent des conversations fluides, du résumé de texte et même de la génération de code avec une fenêtre de contexte de 128K tokens.

Exemple avec un Mac mini M4

Si vous partez de zéro, pas de souci. Avec l’arrivée du Mac mini M4, Apple a poussé encore plus loin les performances de ses puces Apple Silicon.

Avec son petit prix, cette machine est une plateforme idéale pour exécuter des modèles de langage locaux, faire de la transcription audio en temps réel, et même générer des images et vidéos IA avec des performances impressionnantes.

Un Mac mini M4 avec 16 Go de RAM peut faire tourner des modèles 7B à 13B sans difficulté. Un modèle comme Mistral 7B, optimisé pour Metal et le GPU Apple, offre des réponses instantanées avec une consommation d’énergie minimale. Personnellement, j’utilise DeepSeek R1 Distilled (Qwen 7B).

Vous pouvez facilement utiliser LM Studio ou Ollama pour interagir avec l’IA en local, sans passer par le cloud. Si vous travaillez dans la rédaction, la programmation ou l’analyse de données, le Mac mini devient un assistant personnel ultra-performant, capable de générer du texte, résumer des documents et même analyser des PDF directement depuis un modèle open-source.

Sur un Mac mini M4, Ollama tire parti de ces optimisations et permet de générer du texte à une vitesse de 10 à 15 tokens/seconde sur un modèle 7B, c’est donc même mieux qu’un ChatGPT gratuit.

Avec 24 ou 32 Go de RAM ou plus, le Mac mini M4 peut gérer des modèles plus lourds comme Llama 2 13B en pleine précision, voire des modèles 30B en version optimisée. Cela vous permet d’avoir des réponses plus détaillées et précises, tout en restant dans un environnement 100 % local. Si vous travaillez dans la recherche ou la data science, vous pouvez entraîner des modèles plus petits, les affiner avec QLoRA et les exécuter directement sur votre Mac sans passer par un serveur distant.

Etape suivante : l’agent, c’est quoi et comment ça fonctionne ?

Bravo, vous avez déjà franchi une grosse étape : faire tourner un modèle de langage chez vous. C’est une victoire pour votre vie privée et votre portefeuille. Mais avouons-le, au bout de trois jours, on s’ennuie un peu à simplement « chatter » avec une fenêtre de texte. Le véritable intérêt de la tech en 2026, ce n’est plus de discuter avec une machine, c’est de la laisser bosser.

On va donc parler d’agents IA. Contrairement à un chatbot classique qui attend sagement vos instructions, un agent est proactif. Il reçoit un objectif, décompose les étapes nécessaires pour l’atteindre, et utilise des outils externes pour exécuter la tâche.

Le passage au local change tout. En connectant ces agents à votre propre machine, vous leur donnez accès à vos fichiers, vos e-mails ou votre terminal, sans jamais envoyer la moindre donnée sensible sur les serveurs d’OpenAI ou de Google. C’est l’automatisation ultime.

Bref, un agent IA, c’est un LLM boosté par une boucle de raisonnement, souvent appelée ReAct (Reason + Act). Au lieu de cracher du texte au kilomètre, le modèle va d’abord réfléchir. Il se dit : « Pour répondre à l’utilisateur, j’ai besoin de consulter ce fichier, puis de faire une recherche web, et enfin de compiler le tout ». Il va ensuite générer une commande pour utiliser un outil, lire le résultat, et ajuster sa stratégie si nécessaire.

Pour que cela fonctionne en local, il vous faut trois ingrédients. D’abord, un moteur d’exécution comme Ollama ou Llama.cpp. Ensuite, un framework de coordination comme CrewAI ou LangGraph qui sert d’architecte. Enfin, des « outils » : ce sont de petits scripts Python qui permettent à l’IA d’interagir avec le monde réel, comme lire un PDF, scrapper un site web ou exécuter du code dans un bac à sable sécurisé.

Ici, le choix du modèle est très important. Pour qu’un agent soit efficace, il ne suffit pas qu’il sache écrire de la poésie ; il doit être doué en logique. En 2026, un modèle comme Qwen 2.5 (14B ou 32B) ou un Llama 3.1 fait des merveilles. Ils sont optimisés pour l’appel de fonctions (Function Calling), ce qui leur permet de comprendre exactement quand et comment dégainer un outil sans s’emmêler les pinceaux.

Côté logiciel, si vous débutez, je vous conseille CrewAI. C’est le plus simple pour créer une équipe d’agents qui communiquent entre eux. Vous pouvez avoir un « Chercheur » qui fouille le web et un « Rédacteur » qui met en forme, le tout orchestré par votre GPU. Pour ceux qui veulent mettre les mains dans le cambouis, Open Interpreter est une tuerie : il transforme votre LLM local en un assistant qui pilote directement votre ordinateur via le terminal.

Pour ceux qui cherchent une solution clé en main, Accomplish AI est souvent cité comme un outil de référence : cet agent open source (licence MIT) automatise vos dossiers et votre navigation web en restant 100 % local. C’est le couteau suisse ultime qui s’interface nativement avec Ollama, vous permettant de trier vos fichiers ou de résumer vos documents, naviguer sur le web sans jamais qu’une seule donnée ne s’échappe sur un serveur tiers.

Rejoignez-nous de 17 à 19h, un mercredi sur deux, pour l’émission UNLOCK produite par Frandroid et Numerama ! Actus tech, interviews, astuces et analyses… On se retrouve en direct sur Twitch ou en rediffusion sur YouTube !