Dario Amodei acaba de descobrir o verdadeiro preço da ética em 2026. Por se recusar a transformar Claude em uma ferramenta de vigilância em massa, a Anthropic é banida dos servidores do Pentágono.

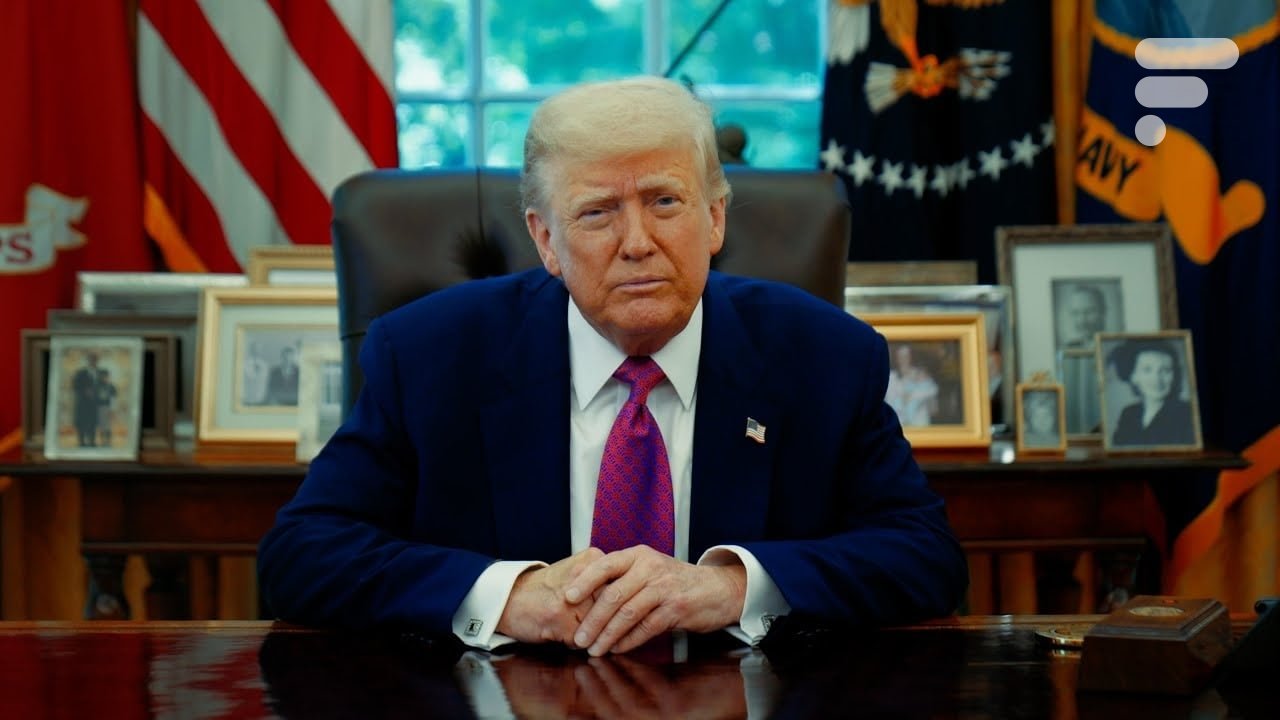

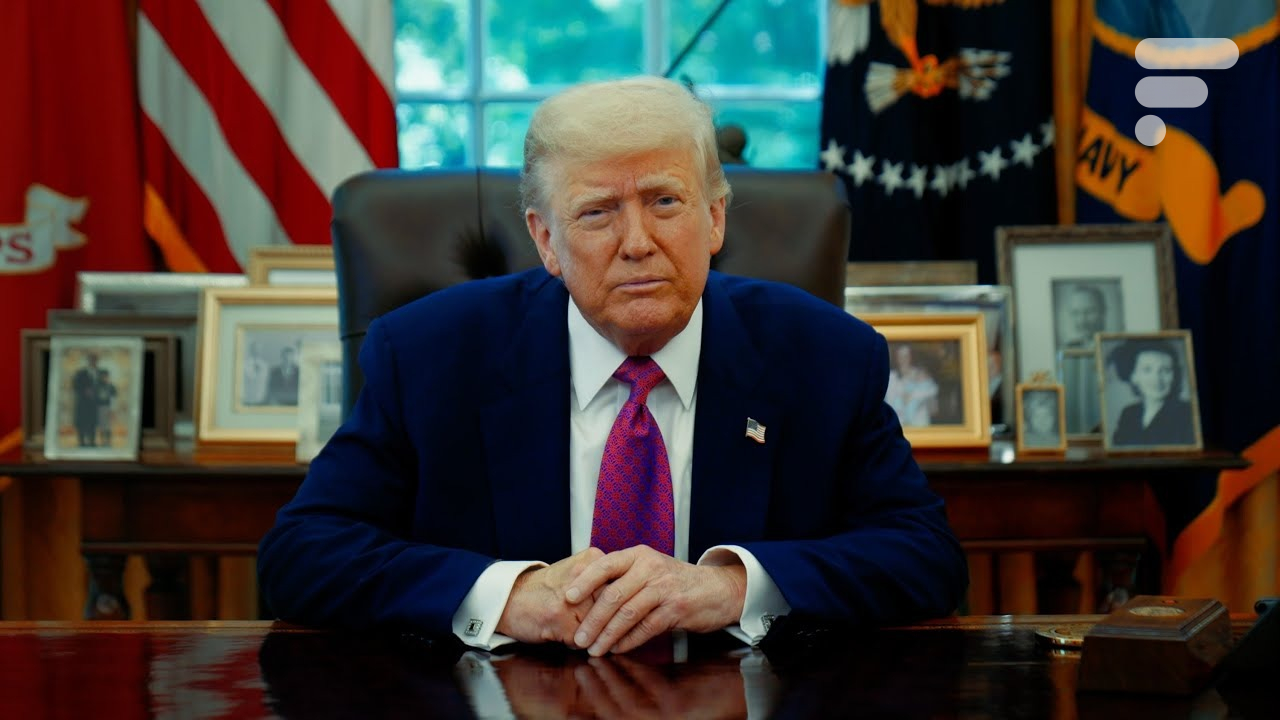

A Antrópico acaba de ser expulsa do rebanho federal americano com rara violência. Tudo começou com uma postagem de Donald Trump no Truth Social. O presidente ordenou que as agências federais cessassem todo o uso dos produtos da start-up no prazo de seis meses. Mas o golpe final veio de Pete Hegseth, o Secretário de Defesa.

Para ir mais longe

Como o Antrópico Claude enfrenta a principal potência militar do mundo

O Pentágono designou oficialmente o Antrópico como um risco da cadeia de abastecimento. Para compreender, este rótulo é normalmente reservado a empresas ligadas a potências estrangeiras hostis. Aqui, o crime da Antrópico é bem diferente. A empresa recusou-se a alterar os seus termos de serviço para permitir que o Departamento de Defesa (DoD) utilizasse Claude para vigilância doméstica em massa e sistemas de armas letais autónomas.

Dario Amodei, o fundador da Anthropic, se destaca. Ele prefere perder contratos suculentos a ver seus modelos pilotarem “robôs assassinos” sem supervisão humana. Mas esta postura moral tem um custo imediato. A decisão de Hegseth proíbe agora qualquer empreiteiro do Pentágono, pensamos em Palantir ou AWSpara realizar qualquer atividade comercial com a Antrópica.

Um divórcio ideológico e técnico

O conflito atingiu seu clímax na tarde de sexta-feira. O Pentágono emitiu um ultimato: a Anthropic deveria aceitar acesso “irrestrito” para qualquer uso legal antes das 17h30.

Claramente, Pete Hegseth exigia a capacidade de integrar Claude em redes confidenciais para qualquer missão, incluindo aquelas que fazem estremecer os comités de ética. Antrópico disse não.

Esta designação como risco para a segurança nacional é uma arma nuclear administrativa. Isso paralisa o ecossistema em torno da marca. Se você é fornecedor do Pentágono, tocar em Claude torna-se radioativo.

O jogo conturbado da OpenAI e as consequências

A OpenAI, portanto, recuperou-se ao concordar em implantar seus modelos nas redes confidenciais do Departamento de Guerra. A promessa de Sam Altman? Manter a “responsabilidade humana” pelo uso da força. É o suficiente para satisfazer Pete Hegseth onde a Antrópico bloqueou. A OpenAI ocupa agora o espaço vazio, pedindo mesmo ao Pentágono que imponha estes mesmos termos a toda a indústria.

Para a Antrópica, a batalha agora está avançando para um terreno jurídico. A empresa anunciou a sua intenção de contestar esta designação de “risco” em tribunal. É uma questão de sobrevivência comercial. Se este rótulo permanecer, Claude poderá ser banido de sectores inteiros da economia americana que dependem, directa ou indirectamente, de contratos federais.