A inteligência artificial (IA) consome muita energia, especialmente durante a fase de treinamento. Este é um problema de tal magnitude queElon Musk previu que o mundo ficaria sem eletricidade para IA dentro de um ano. Mas pesquisadores de Laboratório Cold Spring Harbor nos Estados Unidos talvez tenham encontrado a solução, inspirando-se cérebro humano.

“ Por mais impressionantes que sejam Bate-papoGPT e todas essas tecnologias atuais de IA, em termos de interação com o mundo físicoeles ainda são muito limitados. Mesmo em áreas como resolver problemas de matemática e escrever redações, eles precisam praticar bilhões e bilhões de exemplos antes de conseguirem executá-los bem. “, explicou Kyle Daruwalla, principal autor do artigo publicado na revistaFronteiras na Neurociência Computacional.

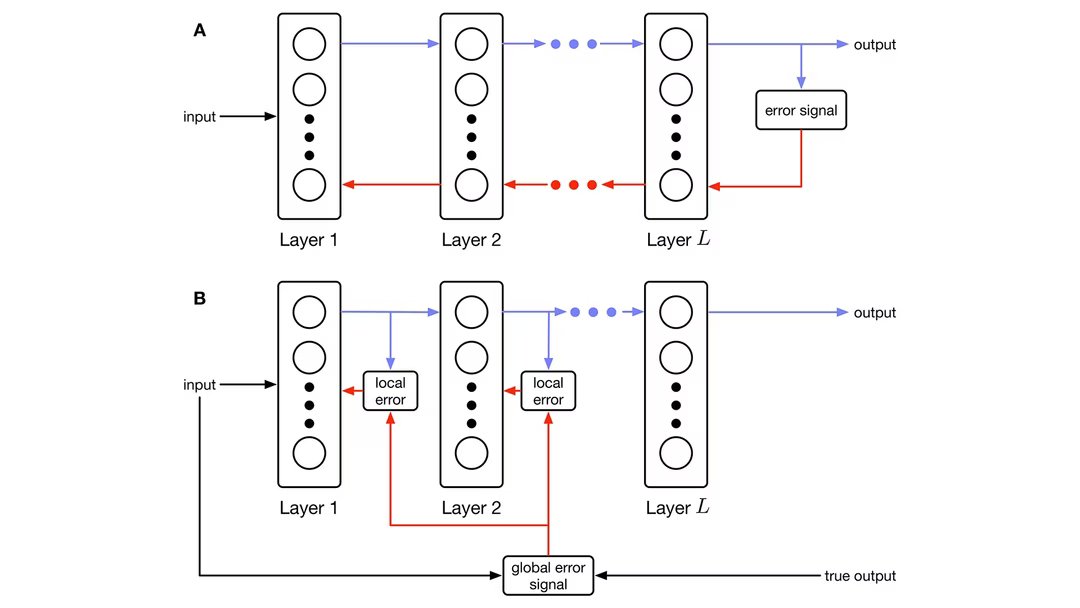

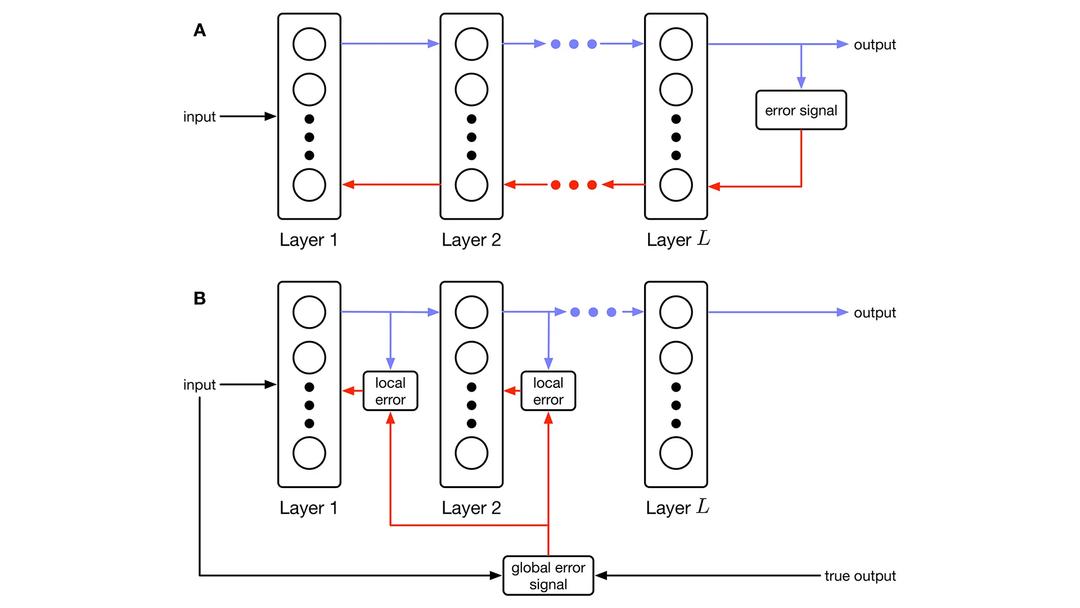

Comparação de uma rede neural clássica (A) com uma nova abordagem (B) que permite feedback para cada camada da rede. ©CSHL

Uma memória de trabalho para permitir a atualização das sinapses

Para ele, o problema está na movimentação de dados. As redes neurais artificiais são compostas por bilhões de conexões e os dados devem passar por circuitos inteiros antes que o modelo seja atualizado. Com esta nova abordagem, cada neurônio artificial recebe feedback através de uma rede de memória auxiliar e pode ser modificado em tempo real.

Isso cria uma conexão direta entre o memória de trabalho e atualizações sinápticas, fornecendo novas evidências para uma teoria não comprovada em neurociência que liga a memória de trabalho à aprendizagem e ao desempenho acadêmico. Esta nova abordagem poderia, portanto, reduzir consideravelmente o poder de computação e, portanto, oenergia necessários para o funcionamento da inteligência artificial.