Sabíamos que o Raspberry Pi estava interessado em IA, mas aqui eles estão claramente avançando. Depois de uma primeira tímida tentativa voltada para a visão computacional, a fundação voltou com o CHAPÉU AI+ 2. Este acessório permite a execução de modelos de linguagem (LLM) diretamente no mapa, localmente, sem enviar seus dados para OpenAI ou Google.

Concretamente, é um módulo que é aparafusado ao seu Framboesa Pi 5 através da interface PCIe. E não é apenas um truque. Com um preço em torno 145 euros (mais caro que o próprio Pi em certas configurações), é um investimento sério. Mas o que realmente ganhamos por esse preço? Isto é o que veremos.

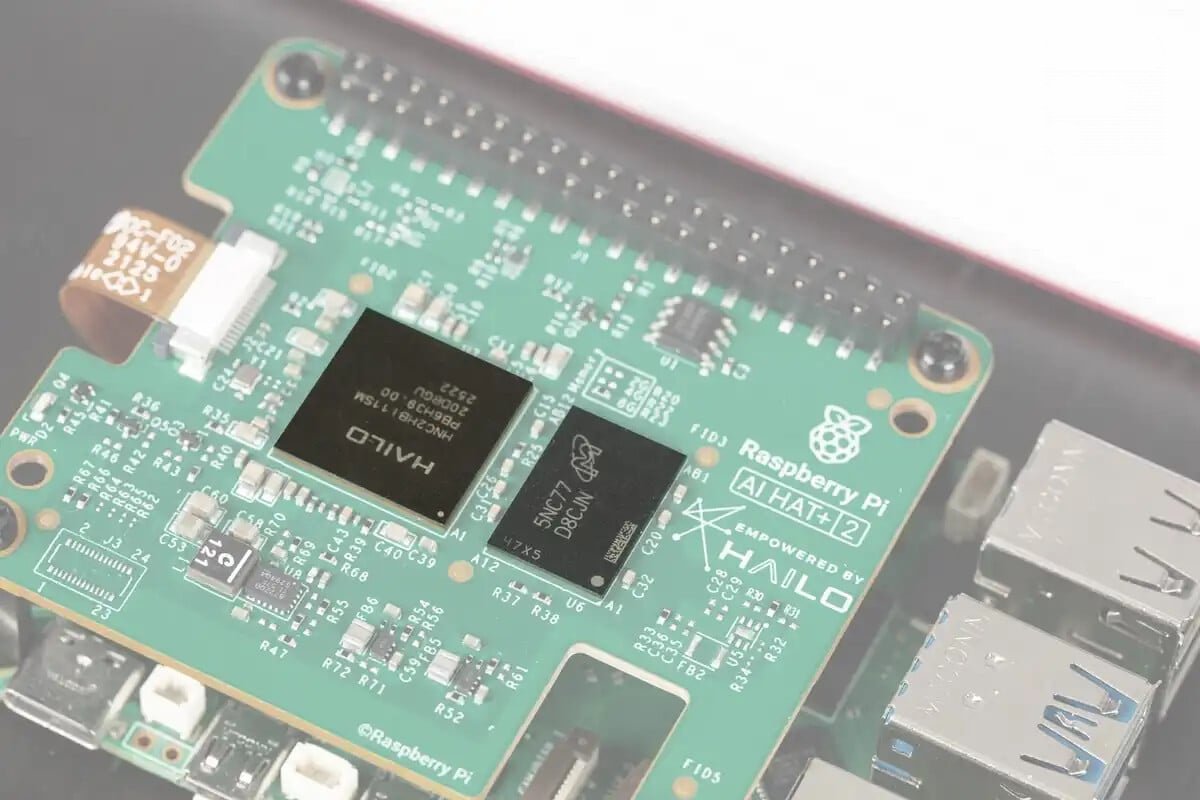

Uma ficha técnica muito correta

Neste mini cartão encontramos um chip Hailo-10H. Se esse nome não significa nada para você, saiba que ele é um acelerador neuronal capaz de entregar 40 TOPOS (Trilhões de operações por segundo) com precisão INT4. Para se ter uma ideia, este é o nível de desempenho dos NPUs (Neural Processing Unit) encontrados nos mais recentes processadores Intel Core Ultra ou AMD Ryzen AI 300. Ter isso em um Raspberry Pi é bastante forte.

Mas o verdadeiro “recurso matador” não é tanto o poder bruto da computação. É memória. O AI HAT + 2 está a bordo 8 GB de RAM LPDDR4X dedicada. Por que isso é importante? Porque normalmente, quando você executa um modelo de IA em um Raspberry Pi, ele canibaliza a RAM do sistema, tornando todo o resto lento ou instável. Aqui, o NPU tem seu próprio campo de atuação. O processador principal e a RAM do seu Pi 5 permanecem livres para gerenciar o sistema operacional e outros aplicativos.

Raspberry Pi promete que você será capaz de rodar modelos como DeepSeek-R1-Destilar, Lhama 3.2, Mistral Ou Qwen. Estamos falando de modelos entre 1 e 1,5 bilhão de parâmetros no lançamento, com possibilidade de subir posteriormente. É uma arquitetura técnica muito inteligente que descarrega completamente a CPU.

O diabo está nos detalhes

Se os números fazem sonhar, a realidade física impõe seus limites. O chip Hailo-10H integrado aqui está limitado a um consumo de 3 Watts. Isso é ótimo para eficiência energética, mas limita o desempenho bruto.

É aqui que o posicionamento fica complicado. Se você já tem um Raspberry Pi 5 com 16 GB de RAMvocê já possui uma máquina capaz de carregar modelos grandes na memória. Claro que é a CPU que está funcionando (e vai sofrer), mas você não tem a limitação de 8 GB da placa de expansão. Para modelos quantizados muito grandes que requerem 10 ou 12 GB de RAM, este acessório será paradoxalmente menos capaz do que um Pi 5 “nu” bem equipado com RAM.

Além disso, a instalação física proíbe o acesso fácil aos GPIOs se você não usar o riser fornecido, e o resfriamento pode se tornar um problema se você empilhar os HATs. É uma solução projetada para eficiência e inferência dedicada, não necessariamente para força bruta absoluta.

Junte-se a nós das 17h às 19h, todas as quartas-feiras alternadas, para o show DESBLOQUEAR produzido por Frandroid E Numerama ! Notícias de tecnologia, entrevistas, dicas e análises… Vejo você ao vivo no Twitch ou retransmissão no YouTube!